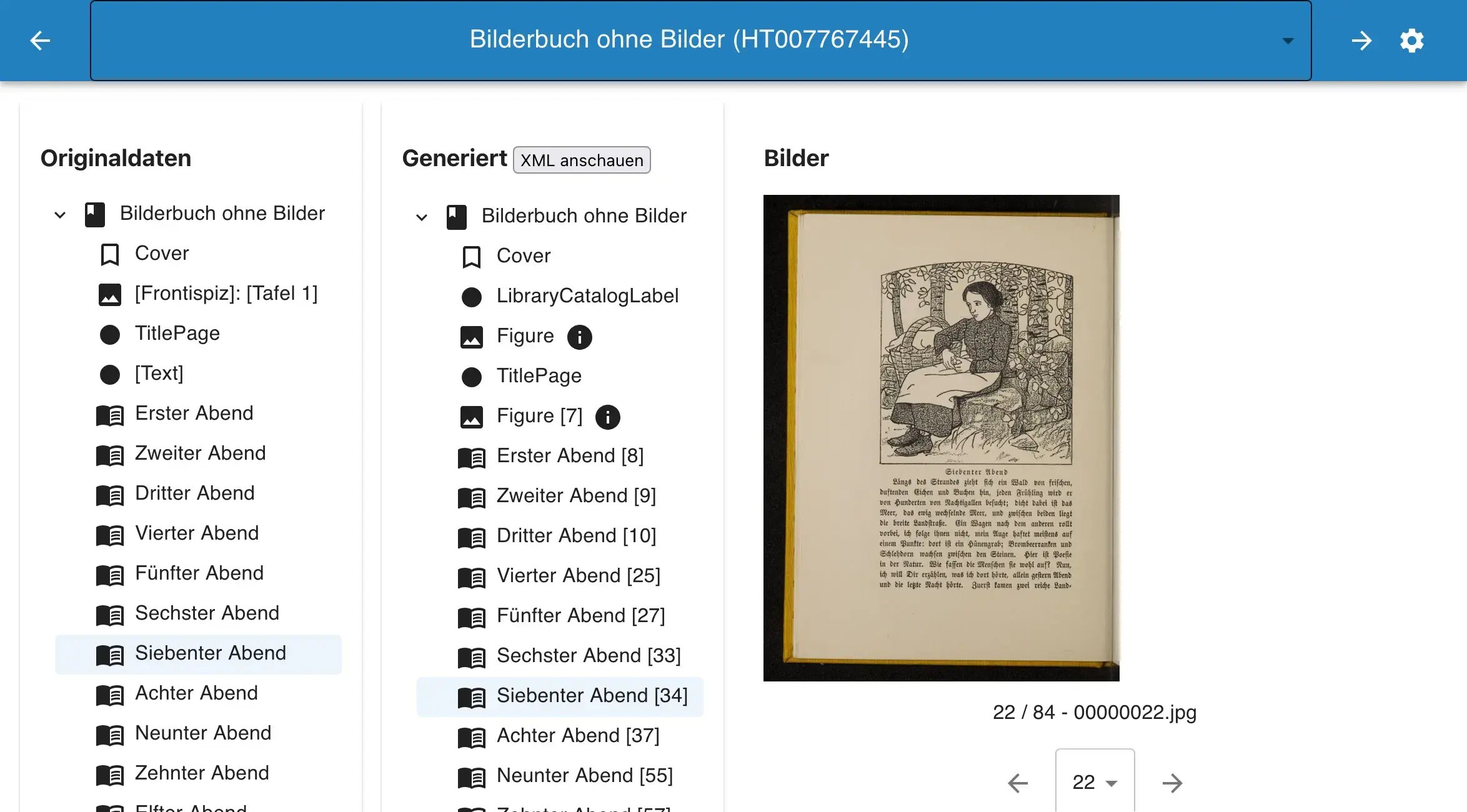

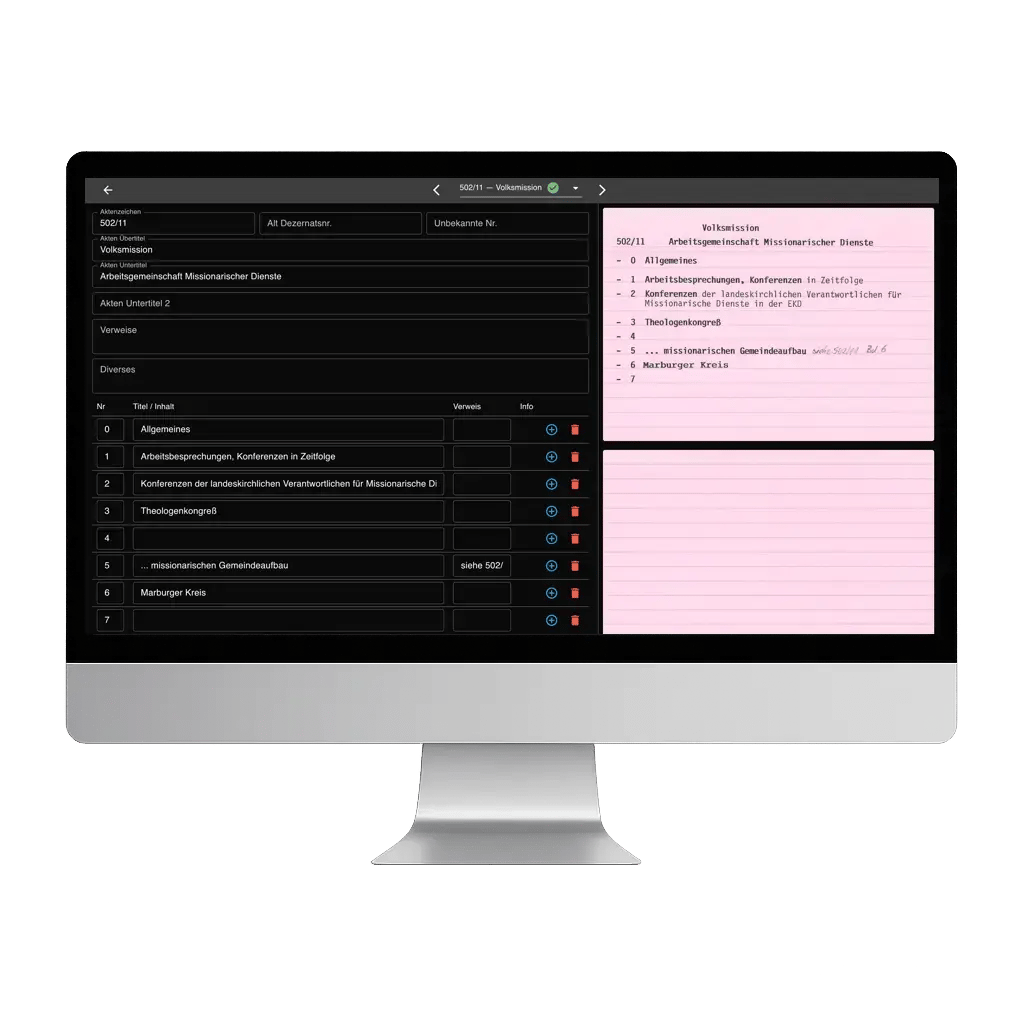

Wahrheit sehen oder eben nicht sehen

Automatische Verschlagwortung

Quelle Foto: “Eye Wash Optical Illusion”, Beitrag von StevenAdelmund auf Imgur

Quelle Foto: “Eye Wash Optical Illusion”, Beitrag von StevenAdelmund auf Imgur

Die automatische Zuordnung von Schlagwörtern zu Texten, Fotos und Filmen ist trotz Verbesserungen in der künstlichen Intelligenz sehr schwierig.

Für KI-Systeme ist es schwer, die Bedeutung von Wörtern und Sätzen in verschiedenen Zusammenhängen zu verstehen. Auch kulturelle Feinheiten und Anspielungen sind schwer zu erfassen.

Sprache und Bilder können nun mal mehrdeutig sein, sodass es schwierig ist, die richtigen Schlagwörter zu finden. Da kann die künstliche Intelligenz menschliches Urteilsvermögen und Interpretation oft noch nicht ersetzen.

Auch hängt die Leistung von KI-Systemen stark von den Trainingsdaten ab. Wenn diese Daten nicht vielfältig oder genau genug sind, kann das KI-System keine guten Schlagwörter erstellen.

Und die Vielfalt der Texte, Fotos und Filme macht es schwer, KI-Systeme zu entwickeln, die alle Arten von Inhalten verschlagworten können. Unterschiedliche Inhalte brauchen eben unterschiedliche Herangehensweisen.

KI-Systeme machen eben auch Fehler und ordnen falsche oder irreführende Schlagwörter zu. Das kann zu ungenauen Suchergebnissen und ethischen Problemen führen. So können bei der automatischen Verschlagwortung Datenschutz- und ethische Fragen auftreten, besonders wenn es um persönliche Daten oder heikle Themen geht.

Deshalb müssen KI-Systeme sorgfältig entwickelt und überwacht werden, um solche Probleme zu vermeiden.

Trotz steten Verbesserungen in der KI-Technologie sind die automatische Verschlagwortung und das Verständnis von menschlichen Inhalten immer noch komplizierte Aufgaben, an denen weiter geforscht und gearbeitet werden muss.

Es bleibt also spannend, oder nur eine Illusion?